Precedence Research calcula que entre 2025 y 2034, la inteligencia artificial aplicada en logística y supply chain crecerá más del 44%; sin embargo, aunque la IA, especialmente la generativa, tiene un gran potencial para impulsar la productividad dentro de las empresas, también está abriendo un nuevo frente de riesgo: el manejo de información sensible en plataformas que, en muchos casos, operan fuera de los controles tradicionales de seguridad. En entornos altamente digitalizados, donde la información fluye entre múltiples actores —proveedores, operadores logísticos, distribuidores y clientes—, la protección y gobernanza de los datos se convierte en un desafío cada vez más complejo.

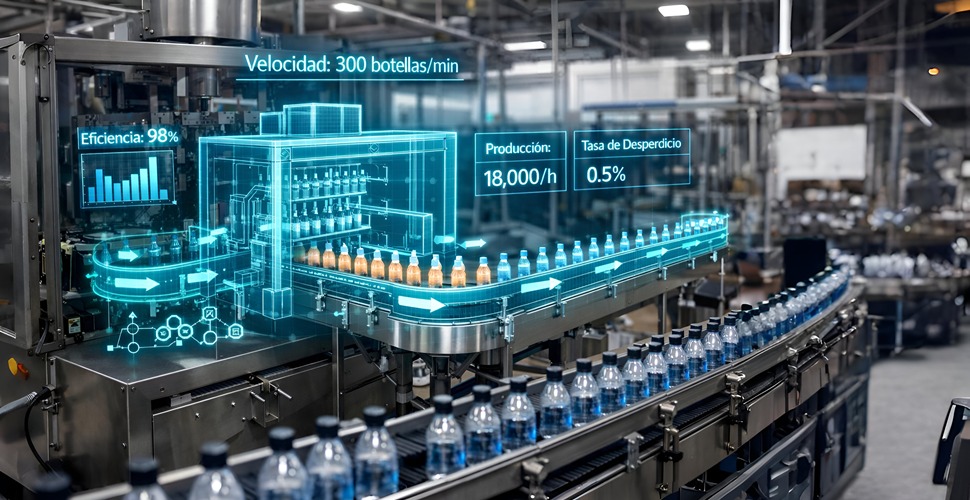

Este tema fue abordado durante la ponencia “Riesgo cuántico e IA: la inminente obsolescencia de su modelo actual de gestión”, presentada por Krishna Narayanaswamy, fundador y CTO de Netskope, en el marco del 2º Foro Ejecutivo de Scitum, realizado el pasado 26 de febrero en Plaza Carso de la Ciudad de México.

Durante su intervención, el especialista advirtió que el uso creciente de aplicaciones de inteligencia artificial dentro de las empresas está modificando el panorama de la seguridad digital, ya que muchos empleados utilizan estas herramientas para procesar información corporativa sin que existan mecanismos claros de control sobre cómo se almacenan o utilizan esos datos.

En este contexto, Narayanaswamy explicó que las organizaciones deberán fortalecer sus modelos de gobernanza de datos para enfrentar tres retos principales:

- La proliferación de aplicaciones de IA generativa dentro del entorno corporativo.

- El riesgo de que información sensible sea expuesta o incorporada a modelos externos.

- La necesidad de establecer controles de seguridad capaces de supervisar cómo circula la información entre usuarios, aplicaciones y plataformas digitales que sostienen la operación de la cadena de suministro.

Expansión de la IA generativa dentro de las empresas

La popularidad de las herramientas de IA generativa ha crecido de forma exponencial en los últimos años, impulsada por su capacidad para automatizar tareas, analizar grandes volúmenes de información y apoyar procesos de toma de decisiones. De acuerdo con lo expuesto por Narayanaswamy, aproximadamente 60% de las organizaciones ya utilizan aplicaciones de IA generativa dentro de sus operaciones, muchas veces sin que existan políticas claras sobre su uso o controles específicos para proteger la información corporativa.

El problema, explicó el experto, es que estas herramientas suelen integrarse en la rutina de trabajo de los empleados de forma espontánea. Analistas, programadores, especialistas en logística o equipos de operaciones recurren a plataformas de IA para resumir documentos, generar código, redactar informes o analizar datos, lo que puede implicar la carga de información sensible en servicios externos.

“Muchas veces los usuarios utilizan cuentas personales o aplicaciones que no forman parte de la infraestructura tecnológica corporativa”, señaló Narayanaswamy durante su ponencia. “Cuando esto ocurre, la organización pierde visibilidad sobre qué información se está compartiendo y cómo se está utilizando”.

Este fenómeno ha dado lugar a lo que algunos especialistas denominan “shadow AI”, una situación en la que herramientas de inteligencia artificial se utilizan dentro de las empresas sin supervisión formal de los equipos de seguridad o tecnología.

El riesgo de que los datos corporativos entren en los modelos de IA

Uno de los aspectos que más preocupa a los especialistas en ciberseguridad es la posibilidad de que información corporativa termine integrándose en los modelos de IA generativa que procesan esos datos.

Muchas plataformas de inteligencia artificial funcionan mediante modelos que se entrenan continuamente a partir de la información que reciben. Cuando los usuarios introducen documentos, fragmentos de código, bases de datos o información interna para obtener respuestas o análisis, existe el riesgo de que esos contenidos se utilicen para mejorar el modelo.

Narayanaswamy explicó que esta dinámica plantea un problema de seguridad relevante para las organizaciones. “Cuando una empresa introduce datos sensibles en una plataforma externa de IA generativa, debe preguntarse qué ocurre con esa información después”, señaló. “En algunos casos, esos datos podrían terminar formando parte del proceso de entrenamiento del modelo”.

Para sectores donde la información tiene un alto valor estratégico —como manufactura, logística, comercio internacional o tecnología— esto puede representar un riesgo importante, ya que datos relacionados con operaciones, procesos productivos o estrategias comerciales podrían quedar expuestos.

Implicaciones para la supply chain digital

La creciente digitalización de las cadenas de suministro ha convertido a los datos en uno de los activos más críticos para las organizaciones. Hoy, gran parte de la operación logística depende de la capacidad de intercambiar información en tiempo real entre múltiples actores.

Sistemas de planificación empresarial, plataformas de gestión de inventarios, redes de transporte, sensores industriales y soluciones de trazabilidad generan continuamente grandes volúmenes de datos que permiten optimizar la operación. Esta información se comparte entre fabricantes, proveedores, operadores logísticos y distribuidores para coordinar procesos, anticipar demandas o gestionar inventarios.

Sin embargo, esta misma interconexión amplía la superficie de exposición frente a posibles filtraciones o usos indebidos de la información. Si datos operativos, contratos comerciales, especificaciones técnicas o registros logísticos se cargan en herramientas de IA generativa sin controles adecuados, podrían crearse vulnerabilidades difíciles de detectar.

En este sentido, el especialista subrayó que la seguridad digital en las organizaciones ya no puede centrarse únicamente en proteger redes o dispositivos; también, debe considerar cómo circula la información entre aplicaciones, usuarios y plataformas de inteligencia artificial.

La gobernanza de datos como prioridad estratégica

Frente a este panorama, Narayanaswamy enfatizó que las organizaciones deberán reforzar sus modelos de gobernanza de datos, entendida como el conjunto de políticas, procesos y tecnologías que permiten controlar cómo se recopila, utiliza, comparte y protege la información dentro de una empresa.

Esto implica, en primer lugar, identificar qué datos son críticos para la operación y establecer reglas claras sobre cómo pueden utilizarse en herramientas de inteligencia artificial; asimismo, supone implementar controles que permitan monitorear qué aplicaciones utilizan los empleados y qué tipo de información se está compartiendo.

“Las organizaciones necesitan visibilidad sobre el flujo de datos dentro de su ecosistema digital”, explicó el experto. “Sin esa visibilidad, es muy difícil establecer controles efectivos”.

Otro elemento clave consiste en educar a los usuarios sobre los riesgos asociados al uso de estas tecnologías; en muchos casos, las filtraciones de información no ocurren por ataques externos, sino por el uso inadvertido de herramientas que procesan datos sensibles.

Hacia un nuevo modelo de seguridad digital

El avance de la inteligencia artificial, combinado con la creciente interconectividad de las plataformas empresariales, está obligando a las organizaciones a replantear sus estrategias de seguridad; ante este nuevo escenario, la protección de la información ya no depende únicamente de sistemas de defensa perimetral o controles tradicionales de acceso.

La seguridad digital comienza a orientarse hacia modelos que priorizan la visibilidad del flujo de datos, el control granular sobre las aplicaciones y la supervisión constante de las interacciones entre usuarios y plataformas digitales.

Para las empresas que operan en entornos altamente digitalizados, como las cadenas de suministro globales, este cambio resulta particularmente relevante. A medida que la inteligencia artificial se integra en los procesos de planificación, análisis y toma de decisiones, la capacidad de gobernar adecuadamente la información se convierte en un elemento fundamental para proteger la integridad de las operaciones.

En este escenario, la gobernanza de datos deja de ser una función exclusivamente técnica y pasa a consolidarse como un componente estratégico para la resiliencia y seguridad de la supply chain digital.

Sobre ponencias de este foro también podría interesarte:

- Ciberseguridad industrial: el nuevo frente de riesgo para manufactura y logística

- Computación cuántica: el nuevo riesgo para la ciberseguridad en la supply chain

- Guía para comenzar a introducir la IA en procesos de logística y supply chain